次なる可能性を秘めたSixthSenseテクノロジー

Pranav Mistry / 青木靖 訳

2009年11月

私たちは身の回りのモノに触れて育ってきました。私たちが日常生活で使うモノはものすごく沢山あります。コンピュータ機器の多くとは違い、日常生活のモノというのは 使うのが楽しいものです。モノについて話題にするとき、それに付随してくるものがもう1 つあります。ジェスチャーです。それらのモノをどうやって扱うのか。実生活でそれらのモノをどう使うのか。ジェスチャーはモノに対してだけ使うわけではありません。人に対しても使います。「ナマステ!」のジェスチャーは誰かに敬意を示すときにします。インドの子供なら、(手を胸の前で水平に振る) これはクリケットの「4 ラン」だと教えられなくとも知っています。生活の中で自然に学び取るのです。

私は早い時期から興味を抱くようになりました。モノやジェスチャーに対する私たちの知識や、実生活でモノをどう使うかということが、デジタル世界をより良くするために役立てられないだろうか? キーボードやマウスを使うかわりに、日常的なジェスチャーでコンピュータを使うことはできないだろうか?

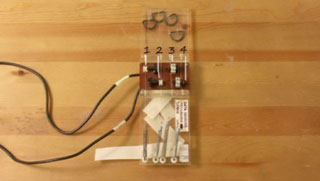

8年ほど前に私はこの探求を始めました。そして自分の机の上にあるマウスをまず手に取りました。それでコンピュータを使うというのではなく、中を開けてみたのです。マウスというのは、昔は中にボールが入っていました。2 つのローラーが、マウスを動かしたときのボールの動きをコンピュータに伝えるようになっています。だから私はこの2 つのローラーに興味を持ち、もっと欲しくなって友達からもマウスを借りました。返すことはありませんでしたが。これでローラーが4 つになりました。そのローラーを使って何をやったかというと、マウスから取り外して一列に並べ、紐と滑車とバネをつけたのです。出来上がったのは ジェスチャーをインタフェースとする装置で、モーションセンサの働きをします。2 ドルでできました。私が実世界でした動きが、この小さな装置を通してデジタル世界で再現されます。2000 年のことです。

2つの世界の統合に私は関心があって、次に考えたのは付箋メモです。普段使っている付箋メモを、電子的な付箋メモへのインタフェースにできないだろうか? 紙に書いたお母さん宛のメッセージがSMS として届き、予定のメモが自動的にデジタルの予定表と同期し、TODO リストも自動的に同期するという具合に。そうすると デジタル世界の中で検索することもでき、「スミス先生の住所は?」といった問い合わせもできます。結果は紙に印刷されて出てきます。これは入出力を紙でするシステムで、紙だけが外に見えています。

別な探求として、私は3 次元に書けるペンというのも考えました。そのペンがあれば、デザイナや建築家が3 次元で考えるというだけでなく、実際に3 次元で書くこともでき、ずっと直感的に使えるはずです。

Google Maps を日常生活の中に引っ張り出せないか?とも思いました。何かを探すために検索語を打ち込むのではなく、モノをその上に載せるのです。搭乗チケットを載せればゲートへの道順を示してくれ、コーヒーカップを置けばコーヒーを買える場所や、ゴミ箱の場所を示すという具合です。

どれも私が初期にやった探求です。私の目的はずっと2 つの世界を継ぎ目なく結ぶということでした。これらの実験にはどれも1 つの共通点があります。身の回りの世界の一部をデジタル世界に持ってこようとしていることです。モノの一部や実生活の直感的な面を考えて、それをデジタルの世界に持ち込む。コンピュータをもっと直感的に使えるようにしたかったのです。

しかし私たちが興味を持っているのはコンピュータ自体ではないということに気がつきました。私たちに関心があるのはコンピュータの中にある情報です。私たちは物事について知りたいと思います。どんなことが起こっているのかを知りたいと思います。

それで去年の初めくらいから考えるようになりました。「このアプローチを逆にすることはできないだろうか?」 デジタル世界を取り出して日常生活の中に投影してみたらどうだろう? (携帯端末を手に) ピクセルデータはこのポケットに入る四角い装置の中に収められています。日常生活の世界へそれを解き放てるなら、ピクセルをいじるために新しい言語を覚える必要もなくなるのでは?

この夢を実現しようと、私は大きなプロジェクタを実際頭に載せてみました。ヘッドマウントプロジェクタというわけです。バイクのヘルメットに切り込みを入れて、プロジェクタがうまく載るようにしました。そうやってデジタル情報で身の回りの現実を拡張できるようになりました。しかし後になって、私はそのデジタル情報も操作したいと思うようになりました。それでデジタルの目として小さなカメラを付けました。その後もっと改良して、コンシューマ向けのペンダント型を作りました。それがご存じのSixthSense デバイスです。

このテクノロジーが特に興味深いのは、自分の行くところはどこへでもデジタル世界を持っていくことができるという点です。どこかの壁を見つけ、それを操作面として使うことができます。カメラがジェスチャーを捉え、様々な身振りを解釈します。初期のバージョンでは、ご覧のようなカラーマーカーを使っていました。どこの壁でもかまいません。壁の前で立ち止まって投影します。追跡するのは一本の指だけではありません。両手の指がすべて使えます。だから地図を両手でつまんで、拡大・縮小ができます。カメラで実際にやっているのは、エッジ認識や色彩認識そのほか沢山の細かいアルゴリズムによる処理です。技術的には結構複雑なのですが、結果としては直感的に使えるものになっています。

これの楽しいところは外に持ち出せるということです。カメラをポケットから取り出すことなく、ただ写真を撮るジェスチャーをするだけで写真を撮してくれます。写真を撮ったら、どこでも壁を見つけて写真を映して見ることができます。「よし、この写真にちょっと手を入れて友達にメールで送ってやろう」。私たちはコンピュータの世界と日常の世界が混じり合う時代を迎えようとしているのです。適当な壁がないときには自分の手のひらの上で簡単な操作をすることもできます。(手のひらに電話のプッシュボタンが投影されている) 手のひらでダイヤルしているところです。

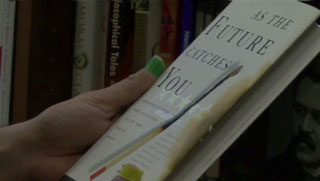

カメラは手の動きを認識するだけでなく、さらには手に持っているモノを認識することもできます。たとえばここでやっているのは、手に取った本の表紙を何千何万というオンラインの情報と照合し、どの本かを調べています。どれかわかったら、その本のレビューを表示したり、ニューヨークタイムズのサイトにある音声による解説を引っ張ってきて、実際の本を手にしながら聞くことができます。(「…ハーバード大学で行われた有名な講演で…」)

これはオバマ大統領が先週MIT を訪れたときのものです。(新聞の上でオバマの映像が動いている「…特にMITの2人の傑出した教授にお礼を言いたい…」) 私は彼の講演のライブビデオを外で普通の新聞の上で見ているわけです。あるいはコンピュータを使わずに新聞でライブの天気情報を見ることができます。(新聞の天気図がアニメーションで動く―拍手)

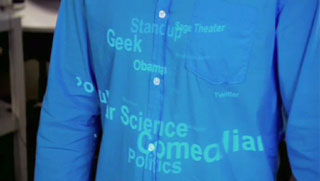

私が帰るときには、搭乗チケットで飛行機の遅れを確認できます。(チケットの上に「20分遅れ」と表示されている) iPhoneを取り出してアイコンを叩くまでもありません。この技術は…ええ (目の前の人の服にタグクラウドが表示されている―笑) モノばかりでなく、人との関わり方も変えます。お遊びとして、ボストンの地下鉄に乗って電車の床で卓球ゲームをすることだって出来ます。 このようなテクノロジーが生活に溶け込むとき、できることを制限するものは自らの想像力だけです。

私たちが扱うのは日常生活のモノばかりではないと言う人もいるでしょう。実際、会計とか編集とかいろんなことをします。そしてあなた方の多くは、次世代のタブレットPC が市場に登場するのを心待ちにしていることでしょう。私はそれをただ待っているのではなく、自分のを紙切れを使って作ることにしました。私がやったのは、Web カメラにはマイクが入っているのですが、それを取り出してクリップにして、紙に付けられるようにしました。どんな紙でも使えます。そうすると紙にタッチしたときに、タッチ音が出るようにできます。実際の指の動きはカメラが把握します。もちろん映画だって見ることができます。(『UP』の映像「こんにちは、僕はラッセル。荒野探検隊 第54 隊の隊員です」) それにゲームも。 ここでは紙をどう持っているかをカメラが把握して、レーシングゲームを操作しています。(紙を傾けるとレーシングゲームの車が曲がる―拍手)

見ることができることについてはお分りいただけたと思います。Web サイトやコンピュータ画面を紙切れの上で見ることができます。どこにいようと。もっと面白いのは、これをもっと生きたものにするということです。自分の部屋に戻ったとき、情報をつまんでパソコンの上に落としてやれば、続きを大きなパソコンでやることができます。(紙PC の上からつまんでデスクトップPC に落とす動作でデスクトップPC の画面が変わる―拍手) コンピュータだけではありません。紙にもできます。紙の世界で遊ぶのはとても面白いです。資料の一部をこちらに取って、別なところからも何か取ってきて、情報をその場で修正できます。「よし、いい感じにできたぞ。印刷しよう」。そうして印刷します。このような20年くらい前にやっていたやり方のほうが、2 つの世界の間で行き来する現在のやり方より直感的です。

最後になりますが、身の回りのモノに情報を統合することで、これら2 つの世界の溝を埋め、デジタルデバイドをなくせるだけでなく、もっと身の回りの世界と繋がり、もっと人間らしく生きられるようになると思います。そして私たちは機械の一部みたいにならずにいられるでしょう。以上です。(スタンディングオベーション) どうもありがとうございます。

クリス プラナフ、はっきり言って君は天才だよ。本当にすごい。これをどうするつもり? 会社を作る予定はあるの? それともずっと研究を続けていくの?

プラナフ 実際メディアラボのスポンサーの中には、この技術をどう発展させるかに関心を持つ企業がたくさんあります。たとえば携帯電話会社はインドのNGO とは違ったことを求めています。「どうして'Sixth Sense (第六感) しかないの? 障害者のための'Fifth Sense'(第五感) があってしかるべきだ。この技術を使えば、彼らが別な仕方で話せるようにできる」

クリス 君自身の計画は? MIT にずっといるの? これで何かするの?

プラナフ これをより多くの人が利用できるようにして、誰でもSixthSense デバイスを開発できるようにしたいと思っています。これのハードウェアを作るのはそんなに難しくはありません。このソフトウェアはオープンソースにする予定です。たぶん来月あたりから公開します。

クリス そいつはすごい。ワオ。

(喝采)

クリス いつかインドに戻ってこようと思っているの?

プラナフ ええ、もちろん。

クリス どういう計画? MIT とインドで時間をどう切り分けるつもり?

プラナフ ここには多くのエネルギーがあり、学びがあります。ご覧いただいたものは私がインドで学んだことを元にしています。そしてコスト効率に目を向けるなら、このシステムは300 ドルです。テーブル型PC みたいなものは2 万ドルもします。あるいはあの2 ドルで作ったマウスジェスチャーシステムは、同じようなものが当時は5 千ドルくらいしました。あるカンファレンスで座長のアブドゥル・カラムに見せたら、こう言ってくれました。「バーバー原子力研究センターでもぜひこれを使わなきゃ」。私はテクノロジーを研究室に閉じ込めておくのではなく、たくさんの人に届けるということにワクワクします。

(拍手)

クリス TED で会った人の意見を聞くと、君は現在の世界で最高の発明家の1 人だと思う。君をTED に迎えられてとても光栄に思います。どうもありがとう。実に素晴らしい。

(スタンディングオベーション)

[これはTED 公式日本語訳です。翻訳をレビューしていただいた永野辰馬氏に感謝します。]

| home rss |

オリジナル: Pranav Mistry: The thrilling potential of SixthSense technology |

|

|

このアーティクルはクリエイティブ・コモンズ・ライセンスの下でライセンスされています。 |

||