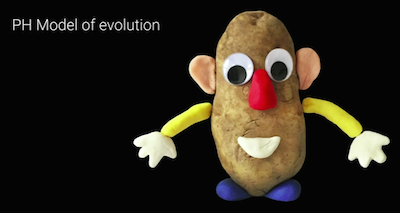

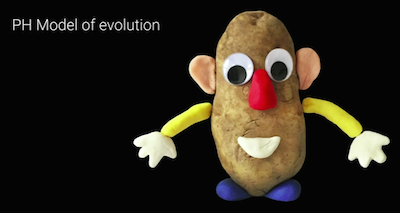

母なる自然が様々な入力チャネルを作り出す自由を生み出しています。私はこれを「進化のPHモデル」と呼んでいます。ここではあまり専門用語を使いたくありませんが、PHは「ポテト・ヘッド」の略です。この名前を使っているのは、私たちがよく知り気に入っている感覚器というのは目にせよ耳にせよ指先にせよプラグアンドプレイの周辺装置に過ぎないことを強調するためです。差し込むだけで準備OK、脳は入ってくるデータの使い方を見つけ出します。

母なる自然が様々な入力チャネルを作り出す自由を生み出しています。私はこれを「進化のPHモデル」と呼んでいます。ここではあまり専門用語を使いたくありませんが、PHは「ポテト・ヘッド」の略です。この名前を使っているのは、私たちがよく知り気に入っている感覚器というのは目にせよ耳にせよ指先にせよプラグアンドプレイの周辺装置に過ぎないことを強調するためです。差し込むだけで準備OK、脳は入ってくるデータの使い方を見つけ出します。David Eagleman / 青木靖 訳

2015年3月 (TED2015)

私たちの体はとても小さなものからできていて、すごく大きな宇宙の中にいるわけですが、そのようなスケールの世界を私たちはあまり上手く把握できません。私たちの脳は、そういうスケールで世界を理解するようには進化して来なかったからです。私たちの認識はむしろ真ん中のほんの薄い領域に捕らわれています。さらにおかしなことに、私たちが自分の居場所と思っているその薄い領域においてすら、私たちは起きていることの多くを見てはいないのです。

たとえば世界の色を例に取って見ましょう。これは光波で、物に反射した電磁波が目の後方にある専用の受容体に当たることで認識されますが、私たちはすべての波長を見ているわけではありません。実際私たちが見ているのは、全体のほんの10兆分の1にすぎません。だから電波やマイクロ波やX線やガンマ線が今まさに体を通り抜けているにも関わらず、まったく気付かないのです。それを捕らえられる感覚受容体が備わっていないからです。何千という携帯電話の会話が今まさに体を通り抜けているというのに、それがまったく見えません。

そういったものが本質的に見えないという訳ではありません。ヘビに見えている世界には赤外線の一部が含まれているし、ミツバチが見る世界には紫外線が含まれています。そして私たちの車のダッシュボードにはラジオ周波数帯の信号を捕らえる機械があるし、病院にはX線領域の電磁波を捕らえられる機械があります。しかし私たち自身はそういったものを感じ取ることができません。少なくとも今のところは。そのためのセンサーを備えていないからです。

それが意味するのは、私たちの体験する現実は生物としての肉体に制約されているということです。私たちの目や耳や指先は客観的な現実を伝えているという思い込みに反して、実際には私たちの脳は世界のほんの一部をサンプリングしているに過ぎないのです。生き物の世界を見渡してみれば、異なる生き物は世界の異なる部分を見ているのが分かります。視覚も聴覚も欠くダニの世界で重要となるシグナルは温度や酪酸です。ブラック・ゴースト・ナイフフィッシュの感覚世界は電場で豊かに彩られています。エコーロケーションするコウモリにとっての現実は空気圧縮波から構成されています。それが彼らに捕らえられる世界の断片なんです。

科学でそれを指す言葉があって、Umwelt (環世界)と言います。「周りの世界」という意味のドイツ語です。どの生き物もきっと自分の環世界が客観的現実のすべてだと思っていることでしょう。立ち止まって自分の感覚を越えた世界があるかもしれないなどと考えはしません。自分に与えられた現実をみんなただ受け入れるのです。

ひとつ意識喚起をしましょう。自分がブラッドハウンド犬だと思ってください。世界の中心にあるのは「におい」です。2億という嗅覚受容体を備えた長い鼻を持ち濡れている鼻孔はにおいの分子を引き寄せて捕らえます。鼻孔には切れ目さえあって、鼻いっぱいに空気を取り込むことができます。犬はすべてをにおいで捕らえます。ある日ふと気づいて足を止めるかもしれません。そして飼い主の人間を見上げて思います。「人間みたいに貧弱で情けない鼻を持っているというのはどんなものなんだろう?」(笑)「空気をほんのちょびっとしか取り込めず、たった百メートル向こうに猫がいることや、お隣さんが6時間前この場所にいたことさえ分からないというのは?」(笑) 私たち人間はそのようなにおいの世界を体験したことがないので、そのことを特に残念とも思いません。私たちは自分の環世界にすっかり馴染んでいるからです。しかし私たちはずっとそこに捕らわれているしかないのでしょうか?

私は神経科学者として技術が私たちの環世界を拡張できる可能性や、それが人間としての体験をいかに変えることになるかに興味があります。技術を生物的な肉体に組み込みうることを私たちは知っています。何十万という人が人工的な聴覚や視覚を使って歩き回っています。その仕組みはマイクを使って信号をデジタル化し電極を直接内耳に繋ぐ、あるいは網膜移植なら、カメラを使って信号をデジタル化し格子状の電極を視神経に直接繋ぎます。15年前という比較的最近まで、そういった技術はうまくいかないと考える科学者がたくさんいました。なぜならそういった技術が話すのはシリコンバレーの言葉で、それは生物的感覚器官の言葉とは違っているからです。しかし実はうまくいくんです。脳はそういった信号の使い方をちゃんと見つけられます。どのようにしてか?

実を言うと、脳というのはそういったものを見も聞きもしてはいないのです。脳は音も光もない頭蓋骨の中に収められています。脳が見るのは様々なケーブルから入ってくる電気化学的な信号だけです。脳が扱うものはそれだけです。脳というのは、そのような信号を取り込んでパターンを抽出し意味付けを行うことに驚くほど巧みで、この内的な宇宙からストーリーをまとめ上げて、皆さんの主観的な世界を作り出しているんです。ここで鍵になるのは、脳というのはそういうデータがどこから来ているのか知らないし、気にもしないということです。何であれ情報が入ってきたら脳はその使い方を見つけ出すのです。脳というのとても効率的な機械です。それは基本的には汎用計算装置で、どんなデータに対してもどう使えばいいか見出すことができ、

母なる自然が様々な入力チャネルを作り出す自由を生み出しています。私はこれを「進化のPHモデル」と呼んでいます。ここではあまり専門用語を使いたくありませんが、PHは「ポテト・ヘッド」の略です。この名前を使っているのは、私たちがよく知り気に入っている感覚器というのは目にせよ耳にせよ指先にせよプラグアンドプレイの周辺装置に過ぎないことを強調するためです。差し込むだけで準備OK、脳は入ってくるデータの使い方を見つけ出します。

母なる自然が様々な入力チャネルを作り出す自由を生み出しています。私はこれを「進化のPHモデル」と呼んでいます。ここではあまり専門用語を使いたくありませんが、PHは「ポテト・ヘッド」の略です。この名前を使っているのは、私たちがよく知り気に入っている感覚器というのは目にせよ耳にせよ指先にせよプラグアンドプレイの周辺装置に過ぎないことを強調するためです。差し込むだけで準備OK、脳は入ってくるデータの使い方を見つけ出します。

動物の世界を見渡すと、様々な周辺機器が見つかります。ヘビには赤外線を感知するピット器官があり、ブラック・ゴースト・ナイフフィッシュには電気受容器があり、ホシバナモグラは鼻先の22本の突起を使って周囲を探って世界の3次元モデルを作り出し、鳥類の多くは磁鉄鉱を備えていて地球の磁場を感じ取れます。これが意味するのは、自然は脳を再設計し続ける必要はないということです。脳機能の基本が確立されたなら、あとは新たな周辺装置のデザインだけ気にすればいいんです。それが意味するのは、我々に備わる器官は別に特別で根本的なものではない、ということです。進化の長い道のりで受け継いできたものというに過ぎず、我々はそれにしがみついている必要はないのです。

そのことの良い例として「感覚代行」と呼ばれる現象があります。これは通常とは異なるチャネルを通じて脳に情報を送るということで、脳はその情報をどうすべきかちゃんと見つけ出します。空論に聞こえるかもしれませんが、これを実証した最初の論文が1969年のネイチャー誌に出ています。ポール・バキリタという科学者が、改造した歯科用椅子に盲人を座らせ、ビデオカメラを設置してその前に何か物を置き、被験者はその映像を格子状に並べた筒型コイルによって背中で感じるようにしました。だからコーヒーカップをカメラの前で動かすとそれを背中に感じるわけです。盲目の人たちは背中の小さな部分の刺激からカメラの前にあるものを驚くほど正確に言い当てられるようになりました。

その後これをより現代化したものがいろいろ現れました。「ソナー眼鏡」は目の前にある物の映像を音の風景に置き換えます。物が近づいたり遠ざかったりすると「ジジジジジジジジジ」と音がします。雑音みたいですが、何週間かすると盲目の人はその音をたよりに目の前に何があるかを非常に良く把握できるようになります。これは別に耳を使う必要はなく、こちらのシステムでは格子状の電気触覚を額に貼り付けて目の前にあるものを額で感じ取ります。なぜ額かというと、他に大して使う用がないからです。最も新しい例はBrainPortと呼ばれるもので、小さな電極の格子を舌に付け、ビデオ映像を電気触感信号に変換します。盲目の人はこれを驚くほどうまく使うことができ、ボールをカゴに投げ入れたり複雑な障害物コースを通り抜けたりできるようになります。舌で見るようになるんです。

突拍子のない話に聞こえるかもしれませんが、視覚は脳の中を流れる電気化学的信号でしかないということを思い出してください。脳はその信号がどこから来たのか気にしません。単にそれをどう使ったらよいか見出すんです。

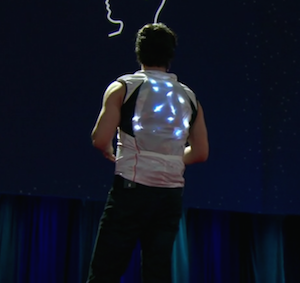

私の研究室で関心を持っているのは、聴覚障害者のための感覚代行です。ご紹介するのは私が大学院生のスコット・ノーヴィックと一緒にやっているプロジェクトで、彼は博士論文に向けてこの研究を主導しています。私たちがやりたいのは、周囲の音を何らかの形に変換し、聴覚障害者が言われたことを理解できるようにすることです。私たちは携帯機器の性能と遍在性を生かし、携帯電話やタブレットで使えるものにしたいと思いました。またこれは身に付けて服の下に着られるものにしたいと思いました。

コンセプトを目にかけましょう。私が話すと、その音をタブレットが捕らえてチョッキに埋め込まれたたくさんのバイブレータに対応付けます。携帯に入っているようなモーターを使っています。私が話した言葉がチョッキの振動パターンへと変換されるわけです。これはただのコンセプトではありません。このタブレットはブルートゥース通信をしていて、私は今そのチョッキを身に付けています。だから私がしゃべると、その音がダイナミックな振動パターンへと変換されます。これによって周囲の音響世界を肌で感じ取ることができます。私たちはこれを聴覚障害者に試してもらっていますが、ほんのわずかな期間でチョッキの言葉を感じ取り理解できるようになることが分かりました。

彼はジョナサン、37歳で修士号を持っています。生まれもっての重度聴覚障害者です。普通の人の環世界の一部が彼には欠けているわけです。それで彼にこのチョッキの訓練を4日間、日に2時間ずつしてもらい、5日目の様子がこちらです。

(映像中 ノーヴィック) You

スコットが言葉を言い、ジョナサンがそれをチョッキから感じ取ってホワイトボードに書いています。

(映像中 ノーヴィック) Where

ジョナサンは複雑な振動パターンを解釈して、言われた言葉を理解することができます。

(映像中 ノーヴィック) Touch

ジョナサンはこれを意識的にやっているわけではありません。パターンがあまりにも複雑なためです。彼の脳がパターンを紐解いて、データの意味を理解するようになっているのです。私たちの予想では、このチョッキを3ヶ月も着ていれば彼は直接的な聴覚の感覚を持つようになるでしょう。ちょうど盲目の人が点字の上に指をすべらせたときに意識的な努力なしに意味が直接ページから飛び込んでくるように感じるのと同じように。

この技術は大きな変化をもたらす可能性を持っています。現在聴覚障害の唯一の解決法は人工内耳ですが、それには外科手術が必要です。しかもこのチョッキは人工内耳の40分の1以下の値段で作ることができ、この技術を広く世界に、最も貧しい国々にも行き渡らせることができます。私たちは感覚代行での結果に強く勇気づけられ、「感覚追加」について考えるようになりました。このような技術を使ってまったく新しい感覚を人間の環世界に付け加えることはできないでしょうか? たとえばインターネットからリアルタイムデータを直接人の脳に送り込んで直接的な認知経験を発達させることはできないでしょうか?

これは私たちの研究室でやっている実験ですが、被験者はインターネットからのリアルタイムデータを5秒間体感します。その後2つのボタンが現れ、どちらかを選択します。被験者は何のデータか知りません。選択が正しかったか1秒後にフィードバックが与えられます。ここで見たいのは、被験者はパターンが何を意味するのかまったく知らないわけですが、どちらのボタンを押せばよいか正しく判断できるようになるものかどうかです。被験者は私たちの送っているデータが株式市場のリアルタイムデータで、自分がボタンで売買の選択をしていることを知りません。(笑) フィードバックで正しい選択をしたかどうか伝えています。私たちが見たいのは、何週間かの訓練の後に、世界経済の動きを直接把握する感覚を持つように人間の環世界を拡張することは可能か、ということです。結果がどういうことになったか追ってご報告します。(笑)

これは私たちが試しているもう1つのことですが、今朝のこのセッションの間、TED2015のハッシュタグがついたツイートを自動的に集めてセンチメント分析にかけています。みんなが肯定的な言葉を使っているか否定的な言葉を使っているかということです。この講演の間ずっと私はこれを感じていました。私は何千という人々の集合的な感情にリアルタイムで繋がっているわけで、これは人にとって新しい種類の経験です。みんなが今どうしていて、どれくらいこれを楽しんでいるか分かるんですから。(笑)(拍手) これは人が通常体験できるよりも大きなものです。

私たちはまたパイロットの環世界を拡張しようとしています。ここではチョッキにクアッドコプターから9種類のデータ—ピッチヨーロール方位方向などが送られていてパイロットの操縦能力を向上させています。パイロットの皮膚感覚が遙か向こうの機体にまで拡張されているようなものです。これはとっかかりに過ぎません。私たちはこれを計器で埋められた現代的なコックピットに適用したいと考えています。個々の計器を読み取る代わりに感じ取れるようにしたいのです。

私たちは情報の世界に生きていますが、ビッグデータにアクセスするのとそれを肌で感じ取るということの間には違いがあります。人間の地平を拡張することの可能性には本当に限りがないと思います。たとえば宇宙飛行士が国際宇宙ステーション全体の状態を感じ取れるというのを想像してみてください。あるいは自分の体の血糖値やマイクロバイオームの状態といった見えない健康状態を感じ取れるというのを。あるいは360度の視覚や赤外線や紫外線の視覚を持つというのを。ここで鍵となるのは、未来へと進む中で私たちは自らの周辺機器を選んでいけるようになるだろうということです。母なる自然が長いタイムスケールで感覚器官を与えてくれるのを待つ必要はありません。良い親が皆するように、世界に出て行って進む道を決めるために必要な道具は既に与えてくれているのですから。今私たちが問うべきことは、自分の世界をどう体験し探索したいかということです。ありがとうございました。(スタンディングオベーション)

アンダーソン これ感じていますか?

イーグルマン ええ、このチョッキで拍手を感じるのは初めてですが、良い気持ちです。マッサージされているみたい (笑)

アンダーソン ツイッターでみんな熱狂し、驚喜している! 例の株式市場の実験ですが、もし成功すれば研究資金に困ることはもうなくなりますね?

イーグルマン そうですね、もう国立衛生研究所に提案を書かなくて済みます。

アンダーソン ちょっとの間だけ懐疑的な見方をしてみましょう。これはすごいものだと思いますが、これまで得られた結果の多くは感覚代行が機能するということで、それは必ずしも感覚追加がうまくいくということではありませんよね? 盲目の人が舌で見ることができるのは視覚中枢があって情報処理できるからで、それが必要な構成要素だという可能性はありませんか?

イーグルマン 良い質問です。実のところ脳はどのようなデータを取り込めるのか理論的な限界を私たちは知りません。しかし一般論として、ものすごく柔軟だとは言えます。人が視覚を失うと、視覚中枢が他のものに引き継がれることになります。触覚や聴覚や言葉によって。それから分かるのは、皮質は単機能で、単にある種の計算を行うということです。たとえば点字のようなものに目を向けると、指で感じるでこぼこから情報を受け取っているのです。理論的な限界があると信ずべき理由はないと思います。

アンダーソン それが正しいとなったらみんな殺到することでしょう。非常に多くの応用が可能です。その準備はできていますか? もっとも期待していること、これが進む方向はどのようなものだと思いますか?

イーグルマン 応用はとてもたくさんあると思います。感覚代行を越えるという意味では、宇宙ステーションの宇宙飛行士という話をしましたが、監視に多くの時間費やす代わりに状況を感じ取れるようになるのではと思います。これが特に適しているのは多次元データだからです。鍵となるのは、私たちの視覚システムは塊や境界を検出するのには優れていますが、世界の状態を把握するのはうまくないことです。無数のデータを表示するたくさんの画面を1つひとつ注意して見ていく必要があります。だからこれは物事の状態を感覚的に把握するための方法になると思います。何もしないでいても自分の体の状態を知ることができるように、重機や安全性、工場や装置の状態を感じ取るというのは、すぐに応用できる領域だと思います。

アンダーソン デイヴィッド、本当に驚嘆させられる話でした。どうもありがとう。

イーグルマン ありがとうクリス。(拍手)

Tweet

| home rss |